AMD udowadnia, że nawet najlepsze GPU nie dadzą sobie rady bez potężnych procesorów

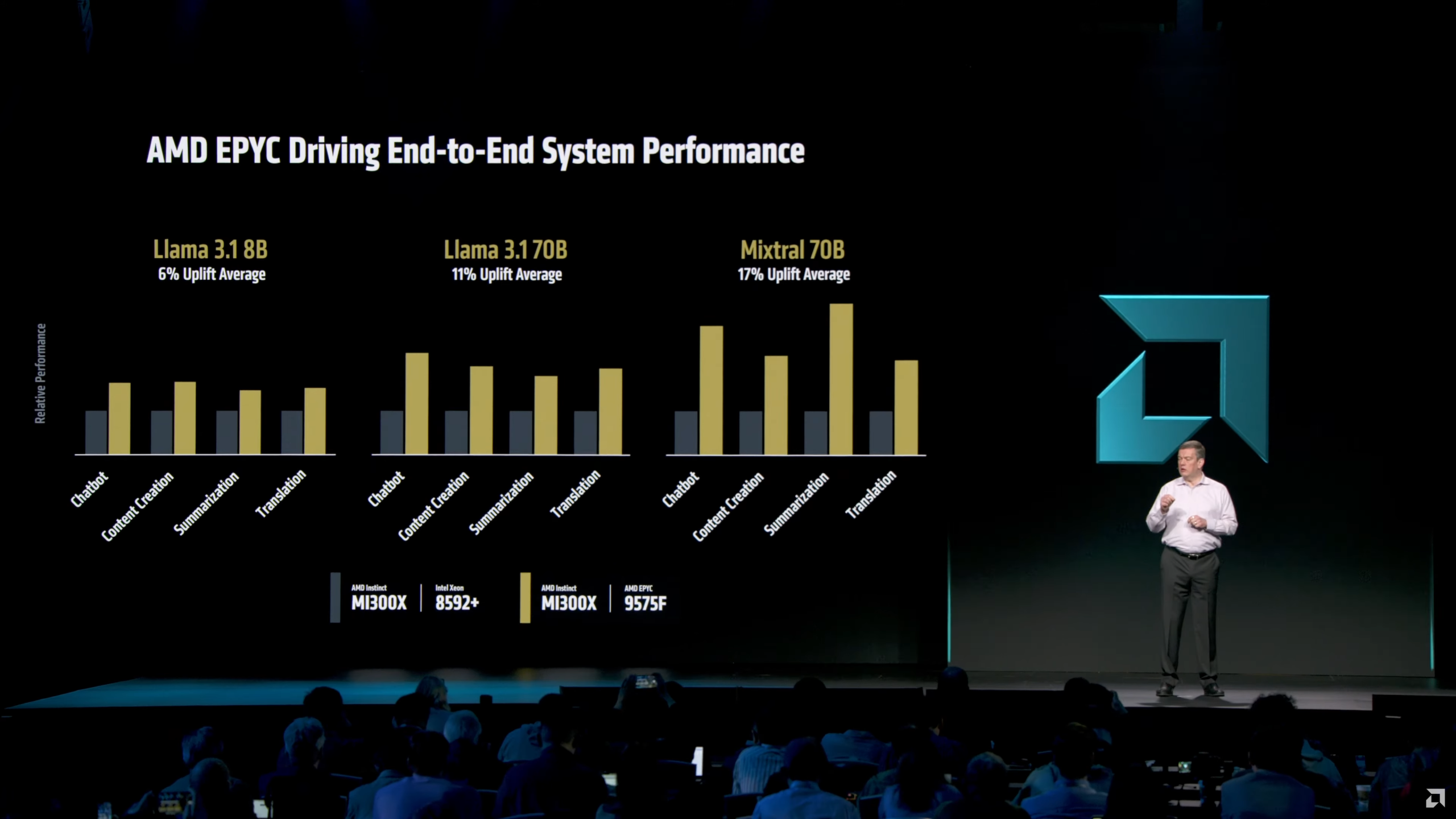

Podczas konferencji Advancing AI, AMD udowodniło, że nawet najpotężniejsze akceleratory sztucznej inteligencji nie pokażą pełni swoich możliwości bez odpowiedniego CPU w serwerach. Firma przedstawiła konkretne dane, które jasno pokazują, że platforma oparta na procesorach EPYC 9005 potrafi zapewnić nawet 17% wyższą wydajność w zadaniach AI, w porównaniu do konkurencyjnych CPU Intela.

W ostatnich miesiącach coraz częściej mówi się o akceleratorach takich jak Instinct MI300X, które AMD promuje jako odpowiedź na potrzeby związane z trenowaniem i inferencją modeli sztucznej inteligencji. Ale, jak podkreślił wiceprezes AMD – Forrest Norrod – to właśnie połączenie odpowiedniego CPU z GPU jest kluczowe dla osiągnięcia topowej wydajności.

Na przykładzie porównania dwóch serwerowych konfiguracji – Intel Xeon 8592+ (5. generacja) oraz AMD EPYC 9575F – obie z 64 rdzeniami i identycznym TDP, AMD pokazało realną przewagę swojej architektury. W testach wykorzystujących model Llama 3.1 8B (popularny model językowy) zestaw z EPYC-iem oferował:

- Średnio 6% wyższą wydajność w wielu scenariuszach inferencji,

- w bardziej wymagających konfiguracjach – nawet do 17% lepiej, gdy rosła liczba parametrów modelu.

Warto dodać, że testy były wykonywane w połączeniu z akceleratorami Instinct MI300X, więc wpływ CPU był analizowany w kontekście współpracy CPU+GPU.

Oprócz samych benchmarków, AMD podkreśliło dynamiczny wzrost adopcji procesorów EPYC w centrach danych. Firma stale zyskuje na znaczeniu w sektorze serwerowym – nie tylko dzięki wydajności, ale też efektywności energetycznej i elastyczności platformy. Dla rynku AI to ważny sygnał: dobór odpowiedniego procesora ma ogromne znaczenie – i może przesądzić o tym, czy inwestycja w akceleratory AI rzeczywiście się opłaci.