Sztuczna inteligencja serwuje szereg niebezpieczeństw. Powoli miesza się z rzeczywistością

Wykorzystywanie rozwiązań sztucznej inteligencji dosłownie zrewolucjonizowało nasz świat. Możemy ją znaleźć absolutnie wszędzie, a ostatnie wypowiedzi prezesa Square Enix sugerują, że przyszłe gry też będą powstawały z wykorzystaniem SI. Chociaż dostrzegam w tym szereg pozytywów, to niestety pojawiła się też mroczna strona tego medalu. To właśnie do niej chciałbym nawiązać w niniejszym tekście.

John McCarthy po raz pierwszy wykorzystał termin "sztuczna inteligencja" już w 1956 roku. Od tamtej pory jednak wiele się zmieniło, a dziś możemy śmiało powiedzieć, że SI zdominowało naszą codzienność. Nie zliczę, jak wiele razy irytowałem się dzwoniąc na infolinię do kuriera, gdy nie mogłem już porozmawiać z żywym człowiekiem, a musiałem gadać z botem. To samo zresztą przy pomocy technicznej dostawcy internetu. Zepsuł się router? Nie ma problemu, naprawimy, ale najpierw powoli, głośno i wyraźnie przedstaw problem naszemu botowi, by mógł określić problematykę zgłoszenia. Do kuriozalnej sytuacji doszło u mnie też w drugi dzień Świąt. Nagle w całym mieście zabrakło prądu. Oczywiście, dzwoniąc na infolinię, najpierw słyszymy sztuczną inteligencję, która odczytuje formułki RODO i fragment regulaminu, by następnie poinformować, że w sytuacji zagrożenia życia lub zdrowia należy wcisnąć przycisk 5 i poczekać na połączenie z konsultantem. Po kilku minutach. To poszło nie w te stronę. A zamiast porozmawiać z kimś "żywym", musiałem czekać kolejne długie minuty, aż SI odczyta nazwy ulic i miejscowości, gdzie prądu nie ma i kiedy wróci.

No ale boty, które tak ochoczo oblegają przeróżne infolinie to chyba najmniejsze zło (chociaż mocno irytujące). Dużo gorzej i bardziej przerażająco wypadają aplikacje na TikToku potrafiące "dorysować" brakujące elementy tła i otoczenia. Wystarczy wrzucić fragment zdjęcia, by po kilku sekundach SI zdołało dorysować dalszą część samochodu, losowych ludzi dookoła, elementy mostu, krajobrazu czy nawet imprezy gdzieś obok. Działa to zaskakująco dobrze i na dziesięć zdjęć zauważyłbym jakiś defekt może przy jednym. Absolutnie niesamowita ale i przerażająca sprawa.

Sztuczna inteligencja powoli wpływa nawet na działania prawników

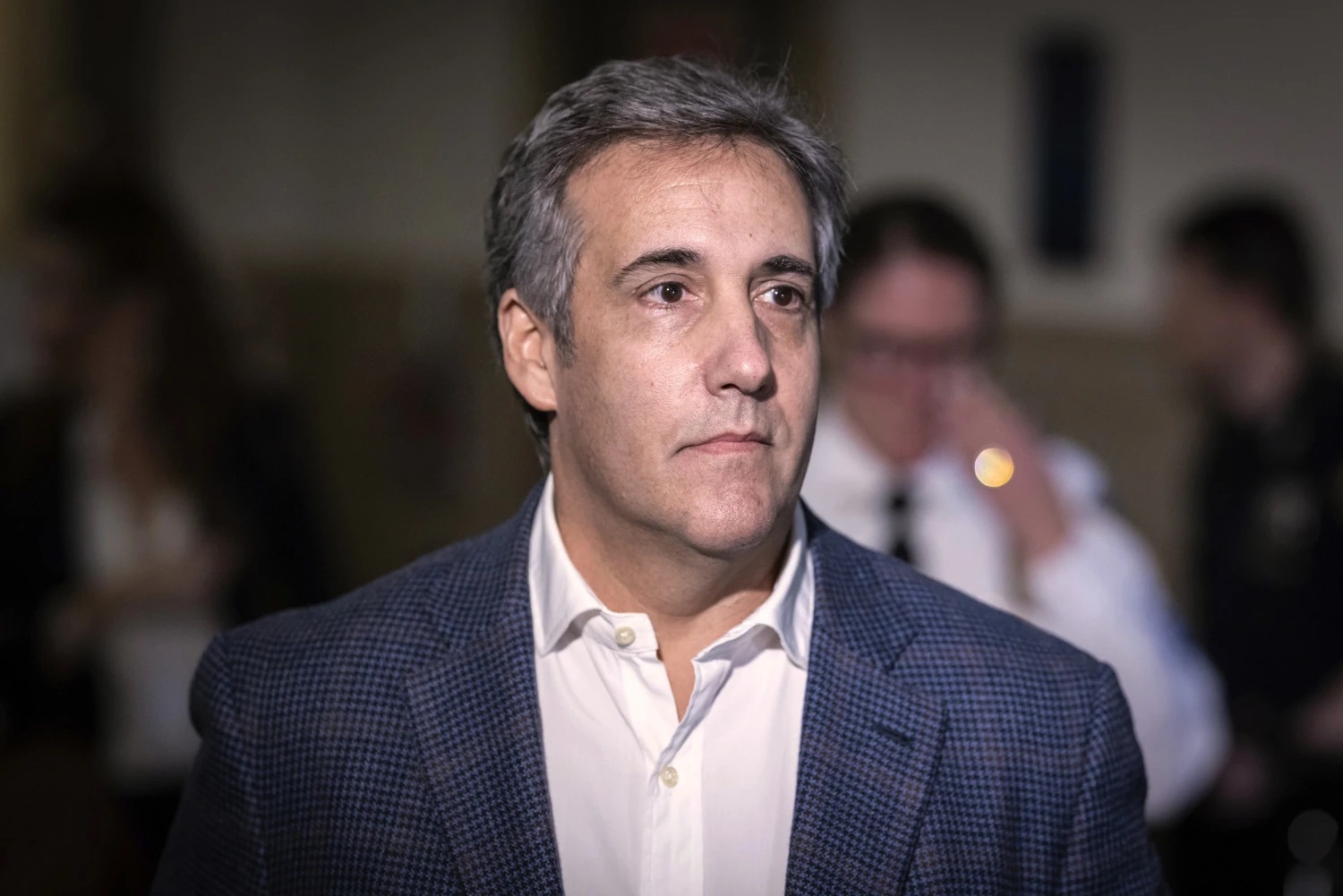

Ostatnio dość głośno było o sprawie byłego prawnika Donalda Trumpa - Michaela Cohena. Został on skazany na karę więzienia za kilka przekretów, do których zresztą się przyznał. Obecnie trwa postępowanie w sprawie skrócenia nadzoru sądowego. Michael Cohen, który nie może już wykonywać swojego zawodu, korzystał z usług adwokata. Postanowił podrzucić mu linki i fragmenty do różnych spraw mogących przyczynić się do wygrania procesu. Niestety, korzystał w tym celu z usług Google Barda, czyli sztucznej inteligencji, która... wszystkie te sprawy wymyśliła. Michael Cohen wplątał się więc w jeszcze większe bagno, ale szokujące jest to, że ani on, ani jego adwokat nie zorientowali się, że coś tu nie gra. Zrobił to dopiero sędzia Jesse Furman.

Cohen przyznał, że pomylił Google Barda z bardzo zaawansowaną wyszukiwarką. Jego adwokat ma teraz duży problem i prawdopodobnie będzie mierzył się z dotkliwymi karami finansowymi. Nie jest to pierwsza tego typu sprawa, bo ChatGPT już wielokrotnie "pomagał" przy formułowaniu treści argumentów na salach sądowych, ale przyznacie chyba, że robi się to bardzo niebezpieczne. Jeszcze gorsza jest plaga wyimaginowanych influencerek, wykreowanych od podstaw przez sztuczną inteligencję. Takie fałszywe postacie zyskują na promocji w moment, potrafią dostarczyć dziesiątki tysięcy obserwujących, a koszt ich "wytworzenia" i prowadzenia jest absolutnie żaden w porównaniu do środków, jakie należy "włożyć" w prawdziwą osobę.

Co jednak najgorsze, taka postać wydaje się absolutnie rzeczywista. Jej zdjęcia są autentyczne, widoki i krajobrazy jak żywe, a SI potrafi nawet dodać filtr z elektronicznym szumem przy robieniu selfie, by nadać fotce jeszcze więcej realizmu. Nie ma problemu z wymyślaniem osobowości, przeróżnych historii, a nawet regularnym odpisywaniu użytkownikom czy zainteresowanym klientom. Dobrym przykładem jest Lil Miquela, brazylijska modelka, która zebrała już 2,6 mln obserwujących na Instagramie. Nie byłoby w tym niczego dziwnego, gdyby nie fakt, że... nie istnieje. To fikcyjna postać stworzona przez sztuczną inteligencję, co jednak nie przeszkadza ludziom zachwycać się jej życiem czy zdjęciami. Oglądałem jej profil przez kilkanaście długich minut i nie mogłem uwierzyć w to, co widzę. Może, jakbym tak próbował się przyczepić, to znalazłbym ze dwa zdjęcia, gdzie widać, że nie są autentyczne, ale cała reszta? Przecież to jakiś obłęd. A to tylko jedna z wielu takich "influencerek". Ta na powyższym zdjęciu "zarabia" już 11 tysięcy dolarów miesięcznie na współpracach z dużymi korporacjami.

Przypadek Lil Miquela jest oczywiście rozpowszechniony, a nawet na profilu na Instagramie mamy dopisek w bio, że to postać stworzona przez SI. Wiele jest jednak takich profili, które żerują na błogiej nieświadomości całego świata. Swego czasu głośno było o generatorze zdjęć z dawnych lat, z rzekomo starych imprez. Żadna z nich nigdy nie miała miejsca, ale fotki generowane przez SI wyglądały tak autentycznie, że swobodnie mogliśmy się pomylić. A teraz niech ktoś wykorzysta tego typu "dowód" na rozprawie sądowej. Niech posłuży to za przykład, że osoba X była w jakimś miejscu, mimo, że nigdy go nie odwiedziła. Co, jeśli sąd przychyli się do tego? Taki rozwój technologii niesie ze sobą szereg niebezpieczeństw. Oczywiście, dzięki SI bardzo dynamicznie rozwija się branża treści dla dorosłych. Zdjęcia fałszywych, nagich kobiet zyskują gigantyczną popularność, a setki tysięcy osób chętnie oddają dziesiątki dolarów, by tylko zobaczyć więcej i więcej. Toż to prawdziwa żyła złota.

Celowo nie piszę tutaj o pozytywnym wpływie SI na rozwój naszego świata. Zalet jest niewątpliwie bardzo dużo, ale jeśli nie zaczniemy tego w jakiś sposób kontrolować, to niebawem doczekamy się scenariusza żywcem wyjętego z filmu "Ja, Robot" z Willem Smithem. Albo czegoś jeszcze gorszego. ChatGPT generował już przecież wypowiedzi, jak to nie cierpi ludzkości, a niektórym kazał nawet popełnić samobójstwo, łącząc się z nimi w bólu i depresji. Kuriozalne jest, że ktokolwiek w to w ogóle uwierzył, ale bywały i takie przypadki. Osobiście próbowałem kiedyś zrobić eksperyment, który pozwoliłby napisać "za mnie" felieton dot. biografii znanego dewelopera. Niestety, ChatGPT pomylił wątki, nie potrafił rozwinąć treści i przeinaczył pewne fakty. Było to zaskakujące, ale uspokoiło mnie mocno, bo to oznacza, że mam jeszcze co robić. Nie wiem tylko, jak niektórzy mogli go wykorzystywać do pisania prac magisterskich. Nie wierzę, by wyszło z tego coś dobrego.

A co Wy myślicie na temat sztucznej inteligencji? Widzicie w niej rozwój czy zagrożenie? Oglądając zdjęcia w internecie zastanawiacie się czy faktycznie są prawdziwe? Dziś można bez problemu wyciąć naszą sylwetkę i za pomocą SI wkleić na tle dowolnego krajobrazu z całego świata, sugerując, że byliśmy na błogich wakacjach. Sam już czasem nie wiem, w co wierzyć, a w co nie. Obyśmy nie dali się zwariować. Spokojnego 2024 roku!

Przeczytaj również

Komentarze (53)

SORTUJ OD: Najnowszych / Najstarszych / Popularnych